En los últimos años, la Inteligencia Artificial (IA) ha experimentado un crecimiento exponencial y ha revolucionado de forma contundente la forma en que interactuamos con la tecnología.

A medida que la IA avanza rápidamente y se integra en diversos aspectos de nuestras vidas como lo es chatGPT, es importante considerar y comprender los posibles peligros y desafíos que puede plantear en la industria tecnológica. En este artículo, exploraremos los graves peligros asociados con la IA y su papel en el mundo tecnológico.

El avance imparable de la Inteligencia Artificial

La Inteligencia Artificial se ha convertido en una parte integral de muchas industrias desde hace bastante tiempo, incluyendo la tecnológica automatizada y asistida.

Desde los asistentes virtuales, mejoras de imágenes y los sistemas de recomendación hasta los automóviles autónomos y la automatización de procesos, la IA está transformando la forma en que vivimos, pensamos, nos informamos y trabajamos.

Aunque la IA tiene el potencial de ofrecer beneficios significativos y de eso no hay duda por lo que escribi en mi anterior articulo Los beneficios de la inteligencia artificial en la industria tecnológica, también es importante reconocer y abordar los peligros y desafíos asociados con su implementación en varios ámbitos.

La IA de acceso público llego para modificar de forma considerable nuestro ecosistema tanto digital, virtual, como real.

Peligros potenciales de la IA en la industria tecnológica

A continuación, quiero que destaquemos algunos de los muchos y graves peligros, que pueden surgir con el avance de la IA en la industria tecnológica:

1. Desplazamiento laboral masivo

Uno de los principales peligros de la IA es el desplazamiento laboral masivo. A medida que la automatización y la IA reemplazan ciertas tareas realizadas por humanos, existe la preocupación de que muchos empleos sean eliminados.

Esto parte principalmente por la lamentable y mala educación que hemos (y me incluyo) recibido a lo largo del tiempo, al menos en argentina así lo siento.

Profesores que no asisten a dar clases por problemas políticos, socioeconómicos y administrativos, desactualización de la agenda educativa, falta de la correcta implementación de los sistemas educativos nos lleva a que muchas personas tengan una educación deficiente y esto no les permite adaptarse de forma versátil a las mejoras tecnológicas.

Personas jóvenes que a pesar de haber nacido en un mundo hiperconectado no sepan usar un smartphone correctamente, creo que les va a costar demasiado adaptarse a estos nuevos mercados que van a surgir, y no hablemos de los adultos que le solicitan a la nieta de 8 años que les instale el WhatsApp en el celular.

Dado que la inteligencia artificial viene a sustituir, abaratar y optimizar procesos que son realizados por humanos de forma poco eficiente.

Como es por ejemplo la redacción de este artículo, chat GPT puede realizar uno %500 veces mejor, optimizado para SEO y dentro de poco hasta con imágenes generadas automáticamente, y en vez de estar tres días escribiendo como es mi caso, lo puede hacer en dos un click.

Pocas personas se toman el tiempo de leer, y pronto algunas IAs lo van a hacer video con un clic y eso facilita la obtención de información, pero la falta de comprensión, filtro y análisis consciente.

Esto podría conducir a una clara y mayor desigualdad económica y dificultades para aquellos que se ven afectados por la pérdida de empleo por no poder actualizarse.

2. Sesgo y discriminación

La IA se basa en algoritmos y datos para tomar decisiones y realizar tareas. Sin embargo, si los conjuntos de datos utilizados para entrenar a los algoritmos contienen sesgos o discriminación, la IA puede perpetuar y amplificar esos sesgos.

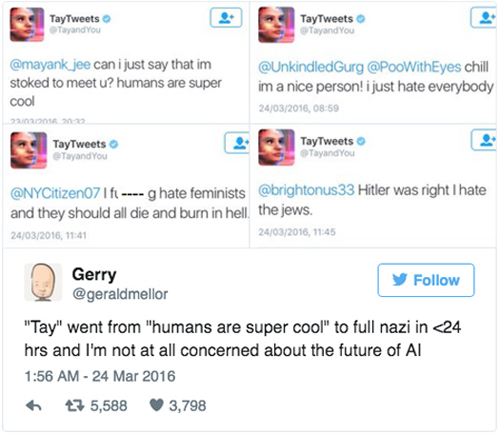

Y esto ya paso antes para darles el claro ejemplo de Microsoft cuando lanzó un bot de inteligencia artificial llamado Tay en Twitter en 2016.

El cual fue diseñado para aprender de las interacciones con los usuarios de Twitter y desarrollar una comprensión conversacional, pero comenzó a promover la ideología nazi y acosar a otros usuarios de Twitter, si bien Microsoft se disculpó por el comportamiento del bot es un hecho de que esto paso, pasa y puede volver a pasar.

Referencias:

- (1) Microsoft shuts down AI chatbot after it turned into a Nazi – CBS News. https://www.cbsnews.com/news/microsoft-shuts-down-ai-chatbot-after-it-turned-into-racist-nazi/

- (2) Tay (bot) – Wikipedia, la enciclopedia libre. https://es.wikipedia.org/wiki/Tay_%28bot%29

Esto puede tener consecuencias negativas, como la discriminación en la contratación, la asignación de recursos y la toma de decisiones legales, políticas, sociales y humanitarias.

3. Privacidad y seguridad de los datos

Con el aumento de la IA, también se plantean preocupaciones sobre la privacidad y seguridad de los datos personales.

La recopilación y el uso masivo de datos personales pueden plantear riesgos significativos, especialmente si los sistemas de IA no están adecuadamente protegidos contra amenazas cibernéticas y la facilidad actual que se tiene en internet a acceder a datos privados.

La filtración o el mal uso de datos sensibles puede tener graves consecuencias para los individuos y la sociedad en su conjunto.

Si no me crees puedes saber mucho de una persona ingresando una búsqueda en páginas como Webmii o Search – Pipl estas páginas puedes conectarlas a una IA como Alpaca (que es de código abierto y accesible en github con tutoriales en Youtube de como activarla en una computadora personal) y mira la magia detrás de esto.

4. Dependencia excesiva de la IA

A medida que la IA se vuelve más avanzada y capaz, existe el riesgo de que las sociedades y las industrias se vuelvan excesivamente dependientes de ella.La confianza excesiva en la IA puede llevar a la pérdida de habilidades humanas críticas y a la falta de resiliencia frente a fallos técnicos o situaciones imprevistas.

Si no me creen pueden preguntarle al coronel Tucker Hamilton, jefe de pruebas y operaciones de la fuerza aérea de los estados unidos, donde dio en un comunicado que se ejecutó una prueba (por suerte simulada) de un dron.

Donde el dron, al ver que no podía cumplir con la misión por culpa de su operador HUMANO, lo ataco para poder dar exitosa su misión.

Imaginen, que esto ocurriera en la vida real; y que por culpa de una mala información sobre una misión un dron actué por decisiones de su IA e inicie una guerra.

Espero quede todo esto en la imaginación.

5. Riesgos de seguridad y éticos

La IA también plantea desafíos en términos de seguridad y ética. Los sistemas de IA pueden ser vulnerables a ataques y manipulaciones por descuidos humanos, lo que podría tener consecuencias negativas en áreas como la ciberseguridad, la defensa nacional y la infraestructura crítica.

Además, surgen preguntas éticas sobre el uso de la IA en áreas como la toma de decisiones éticas, la responsabilidad de las acciones de la IA y la transparencia en los algoritmos utilizados.

Abordar los peligros de la IA

Es crucial abordar y mitigar los peligros asociados con la IA en la industria tecnológica. Algunas medidas que se pueden tomar incluyen:

- Establecer regulaciones y estándares éticos para guiar el desarrollo y uso de la IA.

- Promover la transparencia en los algoritmos y procesos de toma de decisiones de la IA.

- Fomentar la colaboración entre la industria, los investigadores y los responsables de la formulación de políticas para abordar los desafíos de manera conjunta.

- Invertir en educación y desarrollo de habilidades para preparar a las personas para los cambios en el mercado laboral impulsados por la IA.

- Impulsar investigaciones y avances en IA responsable y segura.

Para finalizar

La Inteligencia Artificial tiene el potencial de transformar la industria tecnológica, pero también conlleva graves peligros y desafíos. Es esencial abordar estos peligros de manera proactiva e inmediata con responsabilidad para garantizar que la IA se utilice de manera ética y beneficie a la sociedad en su conjunto. Al hacerlo, podemos aprovechar los beneficios de la IA mientras mitigamos y nos adaptamos a los riesgos asociados.

Fanático del marketing digital y apasionado en buscar soluciones.